23 · 07 · 29 号刊 第 39 期

诸位,见信好。感谢朋友们的支持!

本期选文中《一万小时法则的虚假承诺》阐释了盛行多年的「一万小时法则」的谬误,并提出了综合型人才在复杂领域更具竞争力的观点;近期,七家领先的 AI 公司在白宫就 AI 技术问题做出了承诺,选文《AI 巨头们在白宫做出了什么承诺》详细介绍了这八项承诺的内容,并解释了这将意味着什么。

希望有所启发。

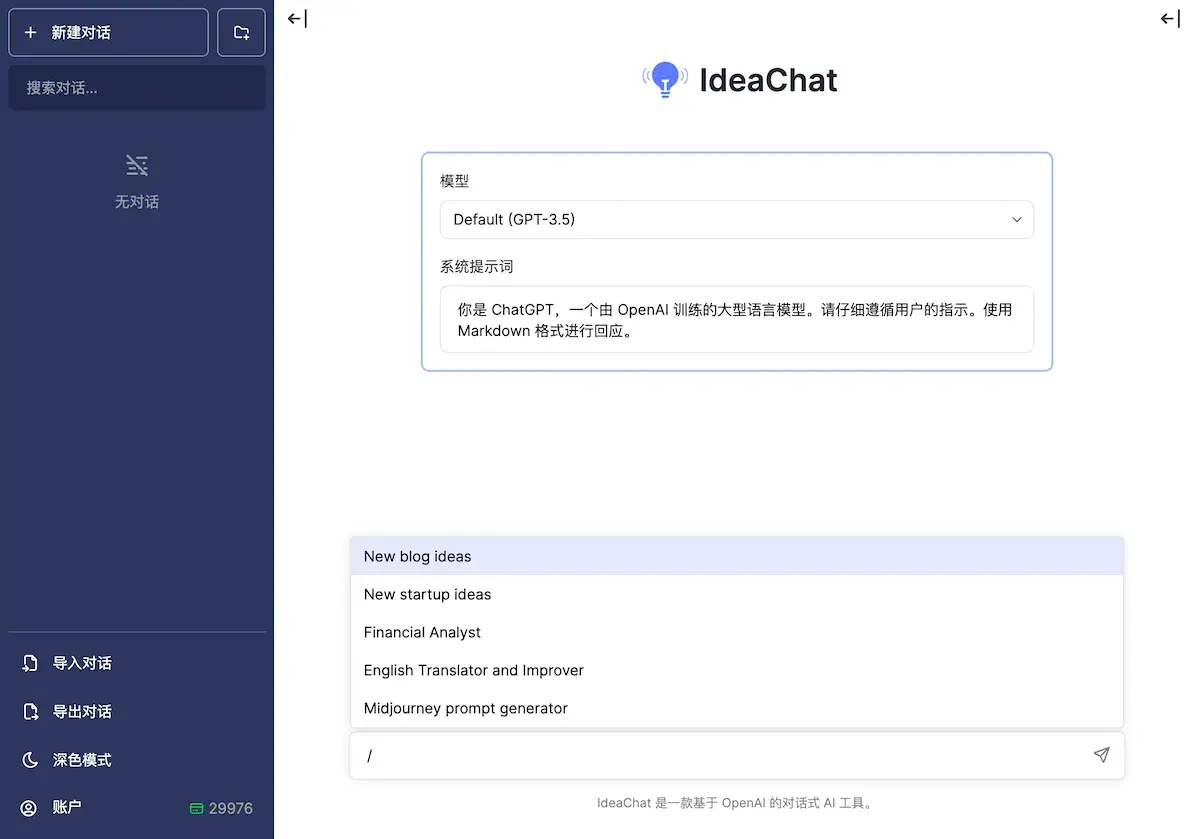

Stream Your Ideas to the Top

IdeaChat →

IdeaChat 是一款由人工智能驱动的对话式应用,助力您实现下一个创想。

注册 IdeaChat 将会免费获得 100 点数以供试用。IdeaChat 支持微信或支付宝付款,为国内用户提供了稳定的使用 ChatGPT 的途径,如果你希望长期使用,请根据自身情况考虑购买服务。

(点击上面的链接订阅或在付款时使用优惠码 SHYRZ 即可享受 8 折优惠,我能从中获得一定比例的返利)

一万小时法则的虚假承诺

→ 原文链接: The false promise of the 10,000 hour rule — Anne-Laure Le Cunff / NessLabs / 2023-06-28

我们的文化崇尚专家。无论是运动员、厨师还是音乐家,一些最著名的名人被视为他们所从事领域的大师,我们敬佩他们为了让自己的技能变得熟练而付出的漫长时间。他们一遍又一遍地练习同一项技能,使之变得如同本能一样。

2008 年,马尔科姆·格拉德威尔(Malcolm Gladwell)出版了他的畅销书《异类》(Outliers),探讨了为什么有些看似非凡的人比其他人取得更大成就。这本书提到了一项对德国音乐学院小提琴学生的研究。书中写道:「许多曾经被认为是与天赋相关的特征实际上是至少 10 年密集练习的结果。」马尔科姆将其称为「一万小时法则」。任何一个主题,只要练习一万个小时,你就会掌握它。

熟不一定能生巧

首先,这项研究并不是在特定的时间内研究一个主题,而是关于刻意练习的。这是一种有系统、有目的的练习,以提高表现为具体目标,需要集中注意力,而不是机械的重复。

更重要的是,这项研究的首席研究员自己似乎也不同意神奇的一万小时法则。

「他误解了,认为每个人实际上都至少花费了一万小时进行练习,所以他们以某种方式通过了这个神奇的界限(……)他们是非常优秀、有前途的学生,很可能在自己的领域中达到巅峰,但在研究时他们仍有很长的路要走。」—— 安德斯·埃里克松(Anders Ericsson),佛罗里达州立大学心理学家、研究员( 来源)

最后,也许是一万小时法则最大的问题,研究中绝对没有任何证据表明,任何人都可以通过一万个小时的练习成为任何领域的专家,即使是刻意练习。为了证明这一点,研究人员必须随机抽取一万小时练习的人作为样本,看看结果是否具有统计学意义。

所有的研究都表明,「最好的」小提琴手比「好的」小提琴手花了更多的时间进行刻意练习。这很有趣,但绝不是专业水平的保证。

事实上, 普林斯顿的一项研究 表明,实践平均只能解释各个领域中表现的 12% 差异。特别是:

- 体育运动 18%

- 音乐 21%

- 游戏 26%

正如弗兰斯·约翰逊(Frans Johansson)在他的《点击时刻》(The Click Moment)一书中所解释的那样,在结构稳定的领域(例如国际象棋、古典音乐或网球)中,刻意和重复的练习效果更好,因为这些领域的规则永远不会改变。但是,当涉及到创业和其他创意领域时,规则一直在变化,使得刻意练习变得不那么有用。

那么,如果熟不一定能生巧,我们怎么去掌握新技能呢?

广度胜于深度

传统学校中用于教授学生的 学习策略 是集中精力在一个技能上,然后再转移到下一个技能,这被称为阻塞(blocking)。但有一种更好的方法:交叉(interleaving),即同时练习多种技能。

研究 表明,随机化信息可以使大脑保持警觉,有助于将信息存储在长期记忆中。这意味着下次你想学习一门新学科的时候,改变可能会获得更好的效果。例如,一些编码开发与一些用户体验设计混合在一起学习,比进行长时间的编码会话要更好。

不仅你将学得更好、更快,而且从长远来看,这还可能使你更加成功。在他的书《广度》(Range)中,大卫·J·爱泼斯坦(David J. Epstein)展示了综合型人才在复杂领域中更有可能成功,而非专家。

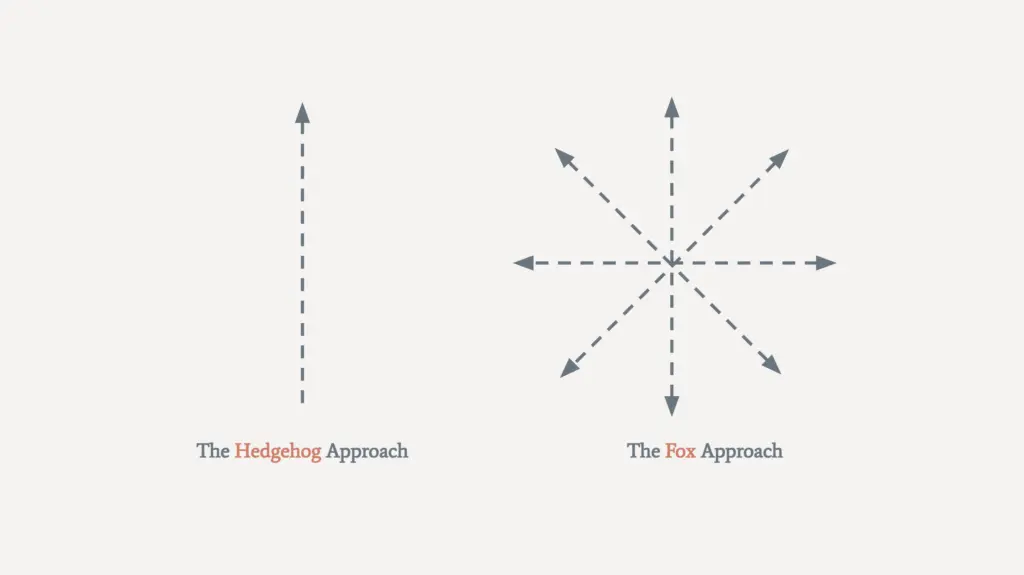

下面的图表基于一句古希腊谚语:「狐狸知道许多事情,而刺猬知道一件重要的事情。」

过于专家化甚至可能是有害的。在《专家的政治判断》(Expert Political Judgment)一书中,菲利普·E·泰特洛克(Philip E. Tetlock)分享了一个实验,要求政治和经济专家做出预测。事实证明,专家们认为不可能发生的结果中,有 15% 最终还是发生了,而四分之一几乎可以确定的结果从未被预测到。

有趣的是,这些专家拥有的经验和资格越多,他们的预测就越离谱。相比之下,那些拥有更广泛专业知识并不受限于特定「专长」领域的参与者在他们的预测中更为成功。

具备跨领域发现新模式并产生创意的能力是非常有价值的。这种超能力很少会以牺牲其他领域的知识为代价而在某一独特领域拥有深厚的专业知识。

因此,忘掉一万小时法则吧。忘掉多年来固守一个专业领域的思维方式。它可能对极少数人有效,但没有证据表明这是最佳策略。下次当你觉得想要学习一些与目前的「领域专长」不太相关的新东西时,去做吧,就是这么简单。

AI 巨头们在白宫做出了什么承诺

7 家领先的 AI 公司就他们将如何利用其技术做出了 8 项承诺,他们都承诺了什么?

→ 原文链接: How Do the White House’s A.I. Commitments Stack Up? — Kevin Roose / New York Times / 2023-07-22

本周,白宫 声明 其已从 7 家领先的 AI 公司获得了「自愿承诺」,以管理 AI 带来的风险。

让包括 Amazon、Anthropic、Google、Inflection、Meta、Microsoft 和 OpenAI 在内的这些公司达成任何协议都是向前迈出的一步。它们之中有的是竞争对手,在进行 AI 研究和开发的方式上存在微妙但重要的差异。

以 Meta 为例,它非常渴望将其 AI 模型交到开发者手中,因此 开源了很多模型,将其代码公开以供所有人使用。而如 Anthropic 的其他实验室, 采取了更谨慎的方式,以更有限的方式发布其技术。

但是,这些承诺究竟意味着什么? 由于没有法律效力的支持,这些承诺是否会对 AI 公司的运营方式产生重大影响?

鉴于 AI 监管的潜在利害关系,细节至关重要。因此,让我们更加仔细地看看这里达成的协议内容,评估其潜在影响。

承诺 1:公司承诺在发布 AI 系统之前对其进行内部和外部安全测试

这些 AI 公司中的每一家都已经在其模型发布之前对其进行了安全测试——通常被称为「红队测试(red-teaming)」。在某种程度上,这并不是一个新的承诺。这是一个模糊的承诺。它没有详细说明需要什么样的测试,或者谁来做测试。

白宫 在一份声明中表示,AI 模型的测试「将部分由独立专家进行」,并将重点关注 AI 风险,「生物安全和网络安全等人工智能风险,及其更广泛的社会影响」。

让 AI 公司公开承诺继续进行这种测试,并鼓励测试过程更加透明,这是一个好主意。还有一些类型的 AI 风险——比如 AI 可能被用来开发生物武器的危险——政府和军方官员可能比公司更适合进行评估。

我希望看到 AI 行业能够就一系列标准的安全测试达成一致,比如校正研究中心( Alignment Research Center)在 OpenAI 和 Anthropic 预先发布的模型上进行的「自主复制」测试。我还希望看到联邦政府资助这类测试,因为这些测试可能很昂贵,而且需要具有重要技术专长的工程师。目前,许多安全测试都由公司资助和监督,这引发了明显的利益冲突问题。

承诺 2:公司承诺在整个行业以及与政府、民间社会和学术界分享有关管理 AI 风险的信息

这个承诺也有些模糊。其中一些公司已经在学术论文或企业博客文章中发布了关于其 AI 模型的信息。其中包括 OpenAI 和 Anthropic,在名为「系统卡片(System Cards)」的文件中还公开了他们为使这些模型更安全而采取的措施。

但他们有时也会以安全问题为由隐瞒信息。当 OpenAI 今年发布其最新的 AI 模型 GPT-4 时,它 打破了行业惯例,选择不披露其训练所使用的数据量有多大,或者说模型的规模有多大(被称作「参数」的指标)。公司表示,由于担心竞争和安全问题,他们拒绝公开这些信息。这也恰好是科技公司不愿与竞争对手分享的数据类型。

在这些新的承诺下,AI 公司会被迫公开这类信息吗?如果这样做有加速 AI 军备竞赛的风险怎么办呢?

我怀疑,白宫的目标不是强迫公司披露其参数数量,而是鼓励相互交换有关其模型构成(或不构成)风险的信息。

但即使是这种信息共享也可能存在风险。如果 Google 的 AI 团队在预发布测试期间阻止了一种新模型被用于设计致命的生物武器,它应该将这些信息分享给 Google 之外的人吗?这是否存在风险,会给不良分子提供如何使用一个防护较少的模型来完成同样任务的想法?

承诺 3:公司承诺投资网络安全和内部威胁防护措施,以保护专有和未发布的模型权重

这个问题比较简单,并且在我与 AI 内部人士的交流中没有争议。「模型权重(Model Weights)」是一个技术术语,用于表示给予 AI 模型运行能力的数学指令。如果你是一个外国政府(或竞争对手公司)的间谍,想要构建自己的 ChatGPT 或其他 AI 产品的版本,那你想要窃取的就是这些权重。这是 AI 公司严格控制的既得利益所在。

模型权重泄漏的问题已经广为人知。例如,Meta 最初的 LLaMA 语言模型的权重在模型公开发布几天后就 被泄露到了 4chan 和其他网站上。考虑到更多泄密的风险——以及其他国家可能对从美国公司窃取这项技术感兴趣——要求人工智能公司加大对自身安全的投入似乎是显而易见的选择。

聆听拜登演讲的依次为 Amazon 的 Adam Selipsky、OpenAI 的 Greg Brockman、Meta 的 Nick Clegg、Inflection 的 Mustafa Suleyman、Anthropic 的 Dario Amodei、Google 的 Kent Walker 和 Microsoft 的 Brad Smith / Anna Moneymaker / Getty Images

承诺 4:公司承诺促进第三方发现和报告其 AI 系统中的漏洞

我不太确定这是什么意思。每家 AI 公司在发布模型之后都会发现其中的漏洞,通常是因为用户尝试利用模型进行不良行为,或者以公司未曾预料到的方式绕过模型的防御措施(一种称作「越狱(jailbreaking)」的做法)。

白宫的承诺呼吁企业针对这些漏洞建立「健全的报告机制」,但目前尚不清楚这意味着什么。应用内反馈按钮,类似于 Facebook 和 Twitter 用户举报违规帖子的按钮?一个漏洞赏金计划,就像 OpenAI 今年启动的 那样,奖励发现系统漏洞的用户?还是其他方式?我们需要等待更多的细节。

承诺5:公司承诺开发稳健的技术机制,以确保用户知晓内容是由 AI 生成的,例如水印系统

这是一个有趣的想法,但留下了很多解释的空间。到目前为止, AI 公司一直努力设计工具,让人们能够判断他们是否正在查看由 AI 生成的内容。虽然有很好的技术原因,但当人们能够将由 AI 生成的作品冒充自己的作品时,这会成为一个真正的问题(问问任何一位高中老师)。而目前被宣传为能够准确检测 AI 输出的许多工具 实际上并没有任何可靠性。

我对这个问题能否完全解决并不乐观。但我很高兴有公司承诺做出努力。

承诺 6:公司承诺公开报告其 AI 系统的能力、限制以及适当和不适当使用的领域

这又是一个听起来很有道理,但回旋余地很大的承诺。公司需要多长时间报告一次其系统的能力和限制? 这些信息需要多详细? 鉴于许多建立 AI 系统的公司在事后都会对自己系统的能力感到惊讶,他们真的能够事先准确描述吗?

承诺 7:公司承诺优先研究 AI 可能带来的社会风险,包括避免有害偏见和歧视以及保护隐私

「优先研究」是一个模糊的承诺。不过,我相信这一承诺会受到 AI 伦理领域中许多人的欢迎,他们希望 AI 公司把防止偏见和歧视等短期危害作为优先事项,而不是像 AI 安全人士那样,担心世界末日的到来。

如果你对「AI 伦理」和「AI 安全」之间的区别感到困惑,你只需知道在 AI 研究界中存在两个敌对派系。每个派系都认为对方所致力于防止的类型是错误的。

承诺 8:公司致力于开发和部署先进的 AI 系统,以帮助应对社会的重大挑战

我认为很少有人会认为先进的 AI 不应该用于解决社会最大的挑战。白宫将「癌症预防」和「减缓气候变化」列为希望 AI 公司专注努力的两个领域,对此我完全不持反对意见。

然而,使这个目标变得有些复杂的是,在 AI 研究中,一些起初看起来不重要的东西往往会有更重要的影响。DeepMind 的 AlphaGo 项目中所涉及的一些技术——一个被训练用于下围棋的 AI 系统——后来证明在预测蛋白质的三维结构方面 非常有用,这是一个重大的发现,推动了基础科学研究的发展。

总体而言,白宫与 AI 公司达成的协议似乎更具象征意义,而非实质性。没有任何执行机制来确保公司遵守,其中许多承诺都是 AI 公司已经采取的预防措施。

不过,这仍然是合理的第一步。同意遵守这些规则表明,AI 公司已经从早期科技公司的失败中吸取了教训,后者一直等到遇到麻烦才与政府接触。在华盛顿,至少在科技监管方面,提前参与是值得的。

- 🏛️社会: 有多少人扬起所谓进步的旗帜开女性权利的倒车

- 💰商业:2003-2023,中国品牌经历了哪些浪潮? 上篇 | 下篇

根据中国政府网数据,2003年,全年社会消费品零售总额达到 45,842 亿元,城镇居民恩格尔系数为 37.1%,农村居民恩格尔系数为 45.6%;而到 2022 年,全年社会消费品零售总额已达 439,733 亿元,城镇居民恩格尔系数和农村居民恩格尔系数分别降至 29.5% 和 33.0%。随着消费潜力不断被承接,中国消费产业多次发生结构性变动,品牌也随之涌现或消亡,构成了中国商业的独特律动。 - 🎙️播客: 流量怪力

一个高中生选择远离世人地独自「去死」,却被流量推动着在众目睽睽下「重生」。 - 🏛️社会: 中国游戏陪玩行业:脆弱的人际纽带,情感需求、孤独与暧昧的窗口

人际关系的解离,欲望孤独的交织 - 🎬娱乐:〔剧透〕 爆火的《芭比》:取悦了女性,却冒犯了男性?

👋如果你喜欢 CyberClip 并愿意帮助我更好地运营下去:

- 转发给朋友或社交网络

- 参见 Advertise 页面联系我投放广告

- 在 爱发电 或微信给我赞赏,欢迎备注称呼、邮箱

- 点击下面带有👆标记的推广链接,你的每一次有效点击我都能收到一份微薄的赞助

- 在你有需求的情况下,通过下面带有⚡标记的推广链接注册付费,我将能从你的支付中获得一定比例(有标注)的返利。请量力而行,理性消费。

❤️感谢你一直以来的支持!

这封邮件是你朋友转发或在社交平台上看到的吗?如果你觉得还不错,欢迎 订阅!

如果你有意愿在 CyberClip 投放广告,请参见我们的 Advertise 页面并与我取得联系。

CyberClip 是一份臻选互联网上有价值内容的赛博剪报。两周一期,涵盖新奇趣闻、热点议题、前沿科技以及其他关于生活、关于未来的事物。

👏 感谢阅读,欢迎回信,敬颂时祺。